RAG(检索增强生成)是当前大模型应用的主流架构,但传统RAG系统的文档解析和检索质量参差不齐,导致AI回答时常出现”幻觉”和”答非所问”。RAGFlow正是为解决这一痛点而生——它通过深度文档理解和知识库融合,打造了目前最精准的开源RAG引擎。

项目介绍

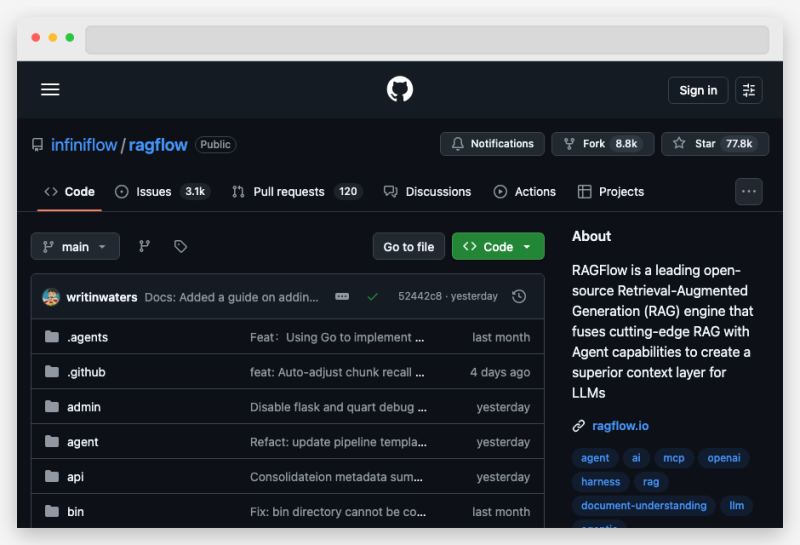

RAGFlow(GitHub stars 77,783)是由Infiniflow开发的开源RAG引擎,它将先进的RAG技术与AI Agent能力相结合,为大语言模型打造了优质的上下文层。项目基于Python开发,核心设计理念是”深度理解文档,精准检索回答”——通过深度文档解析确保检索质量,通过Agent能力实现复杂问答场景。

核心特色功能

1. 深度文档解析

RAGFlow内置强大的文档解析引擎,支持PDF、Word、Excel、PPT、HTML、TXT等多种格式。独特的布局分析和表格识别能力,能够准确理解文档结构,包括多栏排版、表格、图表等复杂元素,确保文档知识被完整提取。

2. 多种文档切片策略

提供多种智能切片策略:按段落、按句子、按标题层次、针对表格的专项切片等。用户可以根据文档类型选择最优切片方式,确保每个切片的语义完整性。

3. 可视化工作流

提供直观的Web界面,用户可以通过可视化方式配置RAG流程:上传文档、选择切片策略、配置向量数据库、构建Agent、测试问答。所见即所得,无需写代码。

4. 多向量数据库支持

支持主流向量数据库:Milvus、Qdrant、PgVector、ChromaDB等。可以根据规模和性能需求选择合适的向量库。

5. Agent能力集成

不只是简单的问答,RAGFlow支持构建复杂的多跳Agent。它可以:调用多个知识库进行联合检索、执行预定义的工作流、处理多轮对话上下文等。

6. 多模态文档理解

支持对图片、扫描件等视觉内容进行OCR识别和理解,可以从图片中提取关键信息融入回答。

7. 支持中文文档

对中文文档有良好的支持,包括中文分词、中文语义理解等。中国用户使用无障碍。

8. 灵活的API接口

提供RESTful API,可以方便地集成到现有系统中。支持批量导入文档、查询知识库、对话问答等操作。

安装步骤

前置要求:Docker、Docker Compose、至少4GB内存

方式一:Docker Compose一键部署(推荐)

# 克隆仓库

git clone https://github.com/infiniflow/ragflow.git

cd ragflow

# 复制环境配置

cp .env.example .env

# 启动服务

docker compose up -d

# 访问 http://服务器IP:9380方式二:自定义配置(生产环境推荐)

# 在.env中配置

# 设置API密钥

HTTP_API_KEY=your_api_key_here

# 配置向量数据库

VECTOR_STORE=milvus

# Milvus连接配置

MILVUS_HOST=localhost

MILVUS_PORT=19530方式三:源码部署(开发者模式)

# 克隆后进入目录

cd ragflow

# 安装后端依赖

pip install -r requirements.txt

# 启动后端服务

python -m uvicorn main:app --host 0.0.0.0 --port 9380

# 前端构建(需要Node.js)

cd web

npm install

npm run build使用方法

第一步:创建知识库

登录后在知识库页面点击”创建知识库”,输入名称,选择文档类型。系统会推荐最优的切片策略。

第二步:上传文档

将PDF、Word等文档拖入上传区域。系统会自动解析文档内容,识别标题、段落、表格等结构。

第三步:配置切片和检索参数

根据文档特点调整切片参数(切片长度、重叠度等)。设置向量模型和检索参数。

第四步:构建Agent

创建AI助手,选择要使用的知识库,配置系统提示词。可以设置对话模式(单轮/多轮)和检索策略。

第五步:测试和部署

在界面上测试问答效果。确认效果满意后,通过API集成到自己的应用中。

适用场景

- 企业知识库:将企业文档、产品手册、规章制度构建为AI知识库,员工随时查询

- 客服机器人:基于产品文档构建智能客服,减少人工客服压力

- 法律文档分析:将合同、判例等文档入库,实现智能法律问答

- 学术研究助手:上传论文和文献,构建研究领域的AI问答系统

- 医疗问诊辅助:基于医学文献构建辅助问诊系统(需专业验证)

- 内部培训系统:将培训资料入库,新员工自主学习并提问

开源协议

RAGFlow采用Apache-2.0开源协议,完全免费使用,可商业部署。

服务支持:如有兴趣不会搭建,可以联系微信:WRYD6166,开源项目搭建10-50元。

暂无评论内容