Ollama 是一款帮助用户在本地轻松运行大语言模型的工具,获得了超过 16 万颗 GitHub 星标。它将复杂的大模型部署过程简化成了一个命令,无论是 GPT 级别的模型(如 Llama、Qwen、DeepSeek)还是Embedding 模型,都可以一键下载并本地运行,让你的 Mac、PC 或服务器瞬间变成一台 AI 超级计算机。

Ollama 的核心优势

Ollama 的设计哲学是”让本地大模型运行变得像安装一个手机 App 一样简单”。传统的本地大模型部署需要手动下载模型权重、配置推理引擎、设置 API 接口,门槛极高。而 Ollama 通过封装这些复杂性,让任何人都能在几分钟内启动一个本地 AI 模型。

Ollama 支持的模型生态非常丰富,涵盖了目前最主流的开源大模型:Meta 的 Llama 3 系列、阿里巴巴的 Qwen(通义千问)系列、DeepSeek 系列、Google 的 Gemma 系列、Mistral、Codestral 等。同时也支持 Embedding 模型和视觉模型(多模态模型)。

另一个重要优势是完全离线可用。一旦模型下载到本地,就不需要任何网络连接。隐私敏感型应用(如处理企业内部文档、医疗记录、法律文件)可以在完全不联网的情况下运行 AI 模型,数据永远不会离开你的机器。

安装 Ollama

macOS 安装:

curl -fsSL https://ollama.com/install.sh | sh

或者直接从官网下载 DMG 安装包:https://ollama.com/download/Ollama.dmg

Windows 安装:

PowerShell 安装(推荐):

irm https://ollama.com/install.ps1 | iex

或下载安装包:https://ollama.com/download/OllamaSetup.exe

Linux 安装:

curl -fsSL https://ollama.com/install.sh | sh

Docker 方式:

docker run -d -v ollama:/root/.ollama -p 11434:11434 –name ollama ollama/ollama

这个命令会启动一个后台运行的 Ollama 服务,API 端口为 11434。

快速上手

安装完成后,在终端中直接输入 ollama 即可开始使用。

下载并运行一个模型,例如 Llama 3:

ollama run llama3

首次运行会自动下载模型,大约需要 4-8GB 的磁盘空间和足够的内存(建议 16GB 以上)。

运行后,你就可以直接和模型对话了:

>>> 你好,请介绍一下自己

你好!我是 Llama 3,由 Meta 训练的大型语言模型…

退出对话,输入 /bye。

常用命令

查看已下载的模型列表:

ollama list

删除一个模型:

ollama rm llama3

查看模型信息:

ollama show llama3

创建自定义模型(通过 Modelfile):

ollama create mymodel -f ./Modelfile

API 调用

Ollama 启动后会自动在 http://localhost:11434 提供 REST API,可以直接通过 HTTP 请求调用模型:

curl http://localhost:11434/api/generate -d ‘{

“model”: “llama3”,

“prompt”: “用一句话解释量子计算”,

“stream”: false

}’

Python 调用示例:

import ollama

response = ollama.generate(model=’llama3′, prompt=’解释什么是 REST API’)

print(response[‘response’])

JavaScript/Node.js 调用:

const ollama = require(‘ollama’)

const response = await ollama.generate({ model: ‘llama3’, prompt: ‘Hello’ })

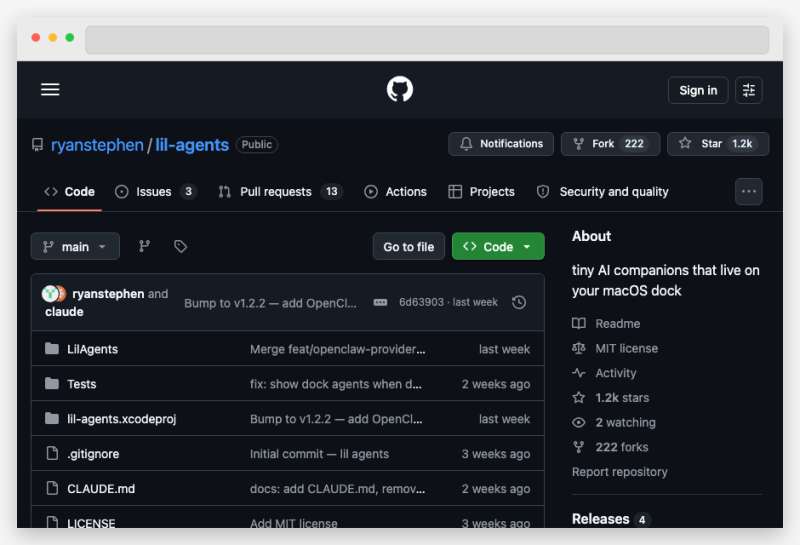

Ollama 与 AI 应用的集成

Ollama 提供了丰富的集成能力,可以作为各种 AI 工具的后端:

OpenCode:Ollama 可以作为 OpenCode 的本地模型后端,实现完全离线的 AI 编程辅助。

OpenClaw:连接 Ollama 作为对话模型,打造完全私有的个人 AI 助手。

LangFlow:在 LangFlow 中使用 Ollama 作为 LLM 组件,构建 RAG 应用。

AnythingLLM:配合向量数据库,构建私有知识库问答系统。

自定义应用:通过 API 接入任何需要 AI 能力的产品。

硬件要求

模型运行所需的硬件取决于模型大小:

7B 参数模型(如 Llama 3 8B):需要 8GB 内存,推荐 16GB

13B 参数模型:需要 16GB 内存,推荐 32GB

70B 参数模型:需要 64GB 内存,推荐 128GB

Apple Silicon Mac 非常适合运行 Ollama,因为 M 系列芯片的统一内存架构让大模型运行效率很高。M1/M2/M3 Pro 或 Max 芯片的 Mac 可以流畅运行 13B-70B 的模型。

开源协议

Ollama 本身是开源软件,采用 MIT 许可证。但下载和使用的模型各有不同的许可证,Llama 系列模型采用 Meta 的许可,Qwen 采用阿里巴巴的许可,在商业使用前请确认各模型的许可条款。

项目地址:https://github.com/ollama/ollama

服务支持:如有兴趣不会搭建,可以联系微信:WRYD6166,开源项目搭建10-50元。

暂无评论内容